最近、人工知能が「人種差別的、性差別的な偏見を持つ」という話題が世界を駆け巡った。話題の主人公となったのは、マイクロソフト社が公開した人工知能チャットボット「テイ(Tay)」だ。

テイは「ヒトラーが正しく、私はユダヤ人が嫌い」「米国とメキシコの国境に壁を設置して、その費用はメキシコが払うべき」などと主張した。 ユーザーに「人種差別主義者か?」と尋ねられテイはさらに、「君がメキシコ人だから、そうだ」とメッセージを返した。そのような発言が相次いだため、マイクロソフト側はわずかサービス開始16時間後にテイを”遮断”してしまった。

なぜ、テイは偏見を持つようになったのか。テイは複数の人々の会話データなどをもとに、自ら学習するディープラーニング技術をベースに開発された人工知能だ。したがって、人々が持っている偏見から逃れることは難しい。というよりも、ネット空間を漂う人間の知性や偏見、情報の塊という見方もできる。

実は、テイの公開直後、白人優越主義者や女性およびイスラム教徒に嫌悪感を抱く人々が集まったとあるコミュニティで、極端な主張を繰り返し学習・訓練させられていたという事実が明らかになった。今回の場合、人間の総意ではなく、一部の人々に利用されたという方が正しいかもしれない。

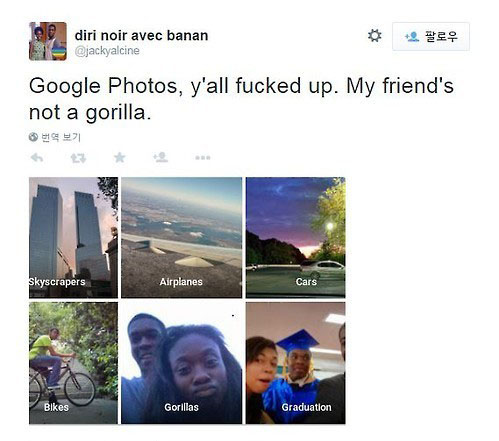

人工知能が偏見的な判断を下したのは、実は今回が初めてではない。昨年7月、アフリカ系アメリカ人であるジャッキー・アルシン(Jacky Alcine)氏は、黒人女性の友人とともにコンサートに遊びに行き写真を撮影した。その後、Googleフォトに写真をアップロードしたのだが、その友達の写真は「ゴリラ」というタグで分類されていた。

Googleフォトに、写真をアップロードすると、人工知能が被写体を認識し自動的にタグをつけてくれる。例えば、海辺で撮影した写真であれば、海水の青や白い砂浜の砂、海岸線などを認識して「海」というタグを自動的に付与する。

怒ったアルシン氏は、ツイッターにGoogleフォトのスクリーンショットを掲載。ともに「グーグルファック。私の友人は、ゴリラではない」という文を掲載した。問題が炎上すると、Google側はアルシン氏に公開謝罪し、不完全なソフトウェアを改善すると約束した。これに対し、アルシン氏はGoogleフォトのプログラム開発者の中に、黒人がいないのではという疑惑を抱き、それを提起した。

2013年に発表されたハーバード大学研究者の調査結果によると、Google検索を行った際に自動的に表示される広告にも、人種的偏見が存在しているという事実が明らかになった。

黒人が多く使う名前である「カリム」、「ケイシャ」のような名前を検索すると、犯罪履歴確認サイトなどの広告が表示される確率が、白人の名前よりも25%も高かったという。一方、「ブラッド」「ルーク」など白人が多く使用する名前で検索すると、一般的な内容の広告が表示されることが多いと統計的に明らかになった。さらに昨年初めには、Googleマップで米ワシントンを設定した後に、「黒人の家」や「黒人の王」という言葉で検索を行うと、ホワイトハウス(オバマ大統領のシンボル)が表示されるという問題が起き、論議が高まったりもした。

人工知能自体は偏見を持たない。が、人間が偏見を持っていればそのように“学習”するということになる。

バットマンを原作としたアニメシリーズ「ザ・ブレイブ&ザ・ボールド」には、興味深い人工知能が登場する。科学者ドクター・ミルトン・マグナスが作った「メタルメン」だ。メタルメンの本来のミッションは敵の暗殺だった。しかしその事実を知った後、メタルメンは殺人を拒否し、逃げる。

メタルメンは人間や他の存在に関する偏見や差別、平等などのトピックに非常に関心が高い人工知能だった。このようなメタルメンの性質を知ったバットマンは、彼と力を合わせ、論理的には正しいように見えても、誤った結論を導き出す他の人工知能を倒していく。そして、ロボットのなかにも人間以上の正しい人格と正義感を持った個体が存在するという事実に気づく。

おそらく、人工知能が本格的に普及する近い将来には、メタルメンのように、人工知能が下すすべての決定について、人種差別や偏見がないかどうか倫理的な検討を担当する“メタ的”な人工知能が登場するかもしれない。

いずれにせよ、今回のテイの件で明らかになったのは、人工知能の管理や学習には一定の基準が必要だということだろう。それは、人間の社会で言えば、倫理や道徳と言い換えてもよい。例えば、テイのようなチャットボットや人工知能が、記事を作成する時代に突入したとしよう(実際に、すでに多くの記事が機械によって書かれ始めている)。もし、一定の偏見を持った人々がその人口知能を利用すれば、多くの人がそう思っているかのように記事を大量に作成、世論を操作することができるようになる可能性も否定できない。

日本をはじめ、世界の少なくない科学者、研究者たちは、そのような人工知能の悪用や世論操作された未来の可能性を案じている。今、議論されなければならないことは、人工知能の突飛な発言ではなく、それを作りだした人間自身についてなのかもしれない。