アルゴリズムによる「自動化された不平等」に対し、懸念が高まっている。アルゴリズムが下した判断は、個人を刑務所に送ることも、労働市場の敗者にすることもできるようになりつつある。これと関連したさまざまな兆候があるが、そのうちふたつをまず紹介したい。

・米国の24の州の裁判所では、判決参考資料として再犯危険性モデルを活用している。犯罪者が再犯する危険性を測定するのに役立つと思われるいくつかのデータや仮定をもとに、アルゴリズムを開発したのだ。受刑者たちは「初めて警察に捕まったのは何歳だったか」「友人や親戚には前科があるか」などの質問に答えなければならない。所得水準が低くスラムに住んでいる黒人の多くは、それらの問いに「はい」と答える確率が高い。結果、黒人の再犯確率は高いと測定されざるを得なくなる。アルゴリズムはその際、人間の偏見を取り除くよりも、技術で覆い隠してしまう。

・2001〜2002年、シカゴ大学とMITの共同研究者は、求人広告を出している約1300の企業に、5000枚の“偽の履歴書”を送った。それぞれの履歴書には、人種的差が明確に見て取れる内容が含まれていた。履歴書の半分には典型的な白人の名前を、残りの半分には典型的な黒人の名前を書いた。そのほかの条件はすべて同じだった。結果、白人の名前を使用した履歴書の反応率は、黒人の名前の履歴書のそれより50%高かったという。米国では、履歴書を機械的に審査するシステムが普及している。アルゴリズムは履歴書を処理しつつ、企業が希望する技術と経験を選び出し、各職務と適合スコアを付ける。履歴書の72%は機械で処理されるので、人間の担当者の審査を受ける機会さえ与えられない。

現在、メディアなどは検索されやすくするように、検索エンジンに適したWebページを設計する必要に迫られているが、上記ふたつの例以外にも、人間は「機械を説得する能力」を強く求められ始めている。そのような状況から、米国の数学者データ科学者であるキャシー・オニール氏は、著書「Weapons of Math Destruction」で冒頭のふたつの例を挙げ、アルゴリズムとビッグデータが不平等を拡散し、民主主義を脅かす可能性を指摘している。

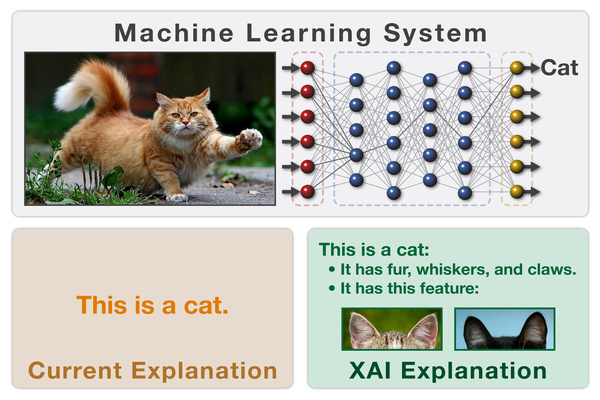

ディープラーニングなど、ここ数年大きな進歩を遂げた技術は、結果だけ知らせ、どんな根拠で判断にいたったのか論理的に説明できないという点が限界として指摘されている。いわゆる「ブラックボックス問題」だ。そのような課題を持った技術を、犯罪危険性の判断や人事評価、軍事作戦、医療分野などに適用すれば効率は向上するだろうが、公正性と正確性を確保する、もしくは公正性と正確性を人間が理解することは難しくなる。そこで注目を浴びているのが、「説明可能な人工知能」(Explainable AI、以下XAI)である。

XAIは、医療・法律・金融・国防など、透明性およびユーザーから“信頼”が要求される分野で活用できるよう、意思決定の理由を人に提示できる人工知能だ。現在、この分野の研究に最も積極的なのは、米国防総省・国防高等研究計画局(DARPA)で、約80億円の予算を投入して研究を進めていると言われている。 MITとグーグルなど民間でも関連研究も活発化している。彼らは主に、ディープラーニングの可視化の過程を研究している。

人工知能が人間の偏見と、誤ったデータを根拠に学習していけば、日常を破壊するほどの危険性を発揮することになる。昨年9月、米スタンフォード大学の研究者は、顔写真だけで同性愛者を識別することができる人工知能を開発していると発表した。出会い系サイトに上がってきた写真を利用して、男性の場合91%、女性の場合83%の精度で同性愛者を区別するというのだ。中国では、潜在的犯罪者を予想する顔認識ソフトウェアまで開発している。

人工知能が誤った判断を下したときにその理由を知ることは、個人の権利でもある。欧州連合は、今年5月25日に施行される個人情報保護法(GDPR)のなかで「欧州連合市民は、法的効力をもたらすか、同様に重大な影響を与える事項について、プロファイリングなどの自動化された処理の適用を受けない権利を有する」と規定している。

プロファイリングとは、アルゴリズムを利用して「私」を特定のタイプに識別することを指す。個人や集団の情報を集めて、職場の業務遂行、経済状況、個人的嗜好、健康、関心ごと、信用度、行動パターン、場所、または移動経路などを分析し、対象を予測・評価する手法だ。「パーソナライゼーション」という名で流通している映画や書籍などの推薦サービス、またカスタマイズ広告は、プロファイリングを利用したものだ。

GDPR 22条は「プロファイリングを含む自動化された意思決定」という項目を扱っている。そこでは、アルゴリズムによる自動化された決定に反対して人間の介入を要求する権利、アルゴリズムの決定についての説明を求め、それに反対する権利などを規定している。つまり欧州連合は、企業の自動化された決定が利用者に大きな影響を与えるという前提で、例えば、信用評価などにおいては、データの主体である自分自身が、情報処理のロジックを知ることができる必要があり、データが収集される過程を拒否するこ権利も付与されなければならないと考えているということになるだろう。

そのような状況においてXAIは不完全なAIが抱える問題を解決・補完することができる手段となる。開発関係者のひとりは、「XAIはシステムを安全にすることができる(中略)例えば、我々が望んでないのにシステムが同性愛者と判断したり、信用評価アルゴリズムが不当に融資を禁止するなどの場合がありうる。その点、XAIが実現すれば差別的偏向が減るだろう」と説明している。

Photo by DARPA