各国の大統領選にまで影響を与え始めていると言われる「偽情報=フェイクニュース」と、その対処への関心が高まっている。ジャーナリストの津田大介氏は、ニュースメディア「ドット(dot.)」に次のように書いた。

「フェイクニュースの影響力は日々増大するばかりだ。4月23日に実施された仏大統領選の第1回投票で、中道系独立候補のエマニュエル・マクロン前経済相と極右政党・国民戦線のマリーヌ・ルペン党首が5月7日の決選投票に進んだ。決選投票では順当に行けばマクロン候補が勝つと見られているが、マクロン候補にとっては油断していられない状況が続く。選挙戦でフェイクニュースを使ったネガティブキャンペーンを何度も仕掛けられたからだ」(「大統領選をも左右するフェイクニュース」2017.05.11)

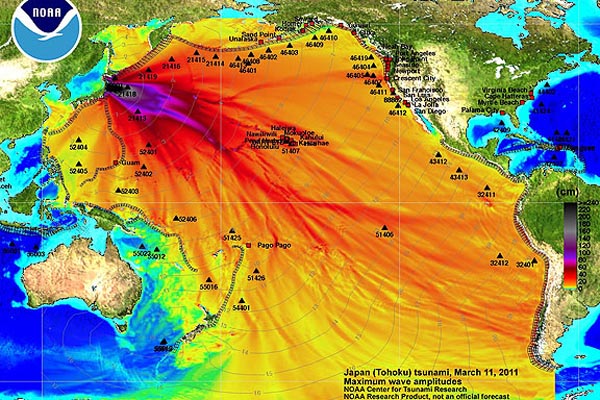

フェイクニュースは、日本とも無関係ではない。過去に「natural news.com」というウェブサイト上には、「福島原発の放射能が太平洋を通じて流出する経路」というニュースが、写真とともに掲載されたことがあった。SNSなどでニュースを共有した世界各国の人々は、衝撃的な内容に仰天。社会不安が一気に煽られることになった。しかしフタを開けてみれば、そのニュースはまったくの嘘だった。ファクトチェックが進められた結果、フェイクニュースであることが判明したのだ。

現在、この手のフェイクニュースは、SNSの普及とともに最盛期を迎えていると言っていい。膨大な数のニュースがネット上に溢れているため、その真偽を人間側が見抜くための時間も、余裕も、手段もなくなってきているからだ。

フェイクニュースの作り手の意図は、大きくふたつ。ひとつは、大量のトラフィックを誘導して商業利益を得るためだ。2016年、米大統領選挙関連のフェイクニュースがマケドニアから発信されたことが大きな問題となった。作成者である10~20代の若者たちは、フェイクニュースをSNSで拡散し、ウェブサイトの広告収入を得ようとしていたことが後に発覚している。

フェイクニュース発信の意図には“政治的工作”という一面もある。これは、いかにも信頼性があるニュースの体裁を取ることで、競争相手や特定の集団を貶めるようというものだ。

韓国大学教育機関の双壁であるKAISTとソウル大学は、2014年からフェイクニュースを判別するための共同研究をスタートさせている。研究から約3年半、分散サーバ50台を接続し、世界5000万のツイッターユーザーが生産した20億のメッセージ、および20億のフォローリンクを分析してきた。結果、現在では膨大なデータをもとに、フェイクニュースのパターンをモデル化するまでにいたったという。それらモデル化されたアルゴリズムで過去に出回ったフェイクニュースを検証したところ、90%の精度で「嘘」であることを見抜くことに成功しているそうだ。

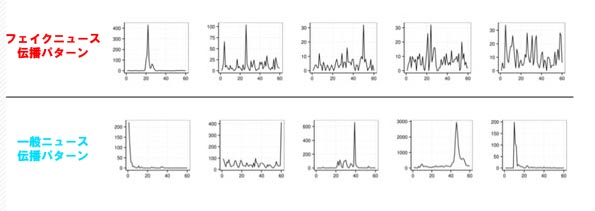

一方、フェイクニュースを人間に見せた際、それを嘘だと見抜ける精度は平均66%だったという調査結果も残されている。人間はメッセージそのものを見て真偽を判断するが、人工知能はメッセージの裏側、つまり様々な「伝播パターン」を捕捉・解析するため、その精度にもおのずと差が出てくるのだという。

なお、フェイクニュースには特徴的な3つのパターンがあるという。まずひとつは、伝播パーンが「ギザギザ」であるということ。これは、一般的なニュースに対して初期にだけ関心が高まり、やがて低くなるパターンとは対照的である。つまり、フェイクニュースの発信者が一定の目標を達成しようと、人為的な検索やコメント書き込みを行っているため、このような伝播パターンが生まれるということになる。

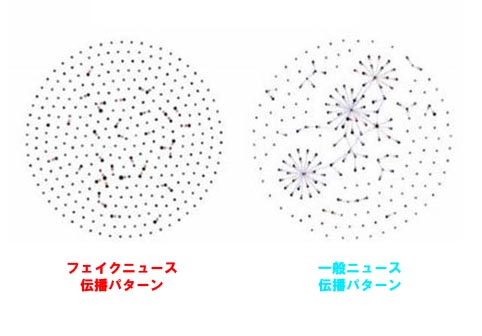

次に伝播者間のネットワーク構造に差がある。フェイクニュースは、関連がないユーザーたちが散発的に参加することで伝播される傾向にあるという。つまり組織が「点」であり、繋がりも希薄で、「線」の組織を形成することができない傾向にある。もう少し分かりやすく言うと、インフルエンサーなどフォロワーが多いユーザーが呼応する割合が低く、そのはじまりから繋がりが少ない人々を通じて伝播すると解釈できる。

最後にフェイクニュースは、一定の「言語的パターン」を伴い伝播する傾向がある。より具体的に言えば、「○○で聞いたのだけれど」、「デマかもしれないが」など「責任回避性言語」が使用される特徴があるという。

このような言語的パターンは、コンピュータアルゴリズムを使用して分析が可能だ。加えて、前述した時間的、構造的伝播パターンは、それぞれの数学的モデルをいくつか作成した後、どのモデルに近いか調べることで分析可能だという。それらの分析においては、ビッグデータや、ディープラーニングなど人工知能が役割を果たす。

今後、フェイクニュースを見破るアルゴリズムにとって課題となっているのは、“時間”だ。嘘が拡散した瞬間、瞬時に真偽を判別できなければ、人々にとって有用とはとても言えない。加えて、一度、広範囲に伝播され始めた情報は、嘘だと分かったとしても制御が難しい。多くの人間が“真実”と信じてしまえば、多かれ少なかれ被害はおのずと生まれてくる。

2008年の大統領選挙当時、「オバマはイスラム教徒である」というフェイクニュースが出回ったが、それを判断するためには約2ヶ月がかかったという。その理由は、データを集め分析する必要があったから。ただ現在では、ディープランニングを使用することで、分析時間が短縮されはじめているという。直近では、「第3次世界大戦が今日起こる」というフェイクニュースが出回ったが、それを嘘だと判断するのにかかった時間は2〜3時間にまで短縮されたそうだ。

韓国の研究チームは、ほどなく数百万件の噂やフェイクニュースを、より迅速に判断できると自信をのぞかせている。昨今、人間がすべて検閲することができないほど膨大なデータが日々生まれては拡散しているが、データさえ確保できれば、人工知能を使った真偽の判断が可能になるというのだ。

人工知能は情報社会に蔓延する嘘を見抜くことができるようになるのだろうか。研究結果だけを聞いている限り、時間や構造、言語的特徴を入力して、数秒以内にフェイクニュースを検出可能になる日は、それほど遠くないように思える。

【関連記事】>>>AIの権威ベン・ゲーツェル氏「人工知能で政治的な腐敗を正せる」

【関連記事】>>>人工知能を教師に…発展途上国で進むAIプロジェクト・YaNetu

【関連記事】>>>「デモ人数」巡る不毛な論争に終止符!? AIが参加者数を正確に計算

福島原発のフェイクニュースに使われた画像